AIコンプライアンス体制の構築ガイド ― 5ステップで始める規制対応と実務設計

EU AI Actの施行やAI推進法の成立を受け、AIコンプライアンス体制の構築が急務です。主要国際フレームワークの比較、リスク分類の実務適用、5ステップの体制構築方法を解説します。

「うちはAIを使っているだけで、開発はしていないから規制は関係ない」——この認識は、すでに危険です。 2024年8月にEU AI Act(EU人工知能規制法)が発効し、2025年には段階的に法的拘束力を持つ規制が適用されています。日本でもAI推進法が2025年に成立しました。AI活用が当たり前になった今、コンプライアンス体制の構築は「やるかどうか」ではなく「いつ始めるか」の問題です。

本記事では、主要な国際フレームワークの比較から、自社のAI用途をリスク分類する方法、そして明日から始められる5ステップの体制構築まで、管理職・法務担当者向けに実務的な手順を解説します。

AIコンプライアンスが「他人事」ではなくなった理由

AIコンプライアンスへの関心が急上昇しています。その背景には、3つの大きな変化があります。

1つ目は、EU AI Actの施行です。世界初の包括的なAI規制法として2024年8月に発効し、2025年2月2日には「許容できないリスク」に分類されるAI(社会的スコアリングや公共の場での無差別な顔認証など)の提供・利用が全面禁止されました。さらに2025年8月2日からは、ChatGPTなどのLLM(大規模言語モデル)を含む「汎用目的AI(GPAI)」の提供者に透明性義務が課されます。

2つ目は、制裁金の重さです。EU AI Actの違反に対する制裁金は、世界売上高の最大7%に達します。そして重要なのは、EU域外の企業であっても、AIシステムをEU市場で提供・運用している場合や、AIの出力がEU域内で利用される場合は「域外適用」の対象になるという点です。日本企業も無関係ではありません。

3つ目は、日本国内の動きです。2025年にAI推進法が成立し、経済産業省・総務省が策定した「AI事業者ガイドライン」は2024年4月の第1.0版に続き、2025年に更新版が公開されています。さらに、日本独自の「AI基本法(仮称)」の制定に向けた議論も2025年中に進行中です。

レビュー・審査業務でAIを活用している組織にとって、コンプライアンス体制の構築は経営課題です。AIがどんな判断をしたか、その根拠は何か、人間はどの段階で関与しているか——これらを説明できなければ、規制への対応はもちろん、取引先や顧客からの信頼も維持できません。

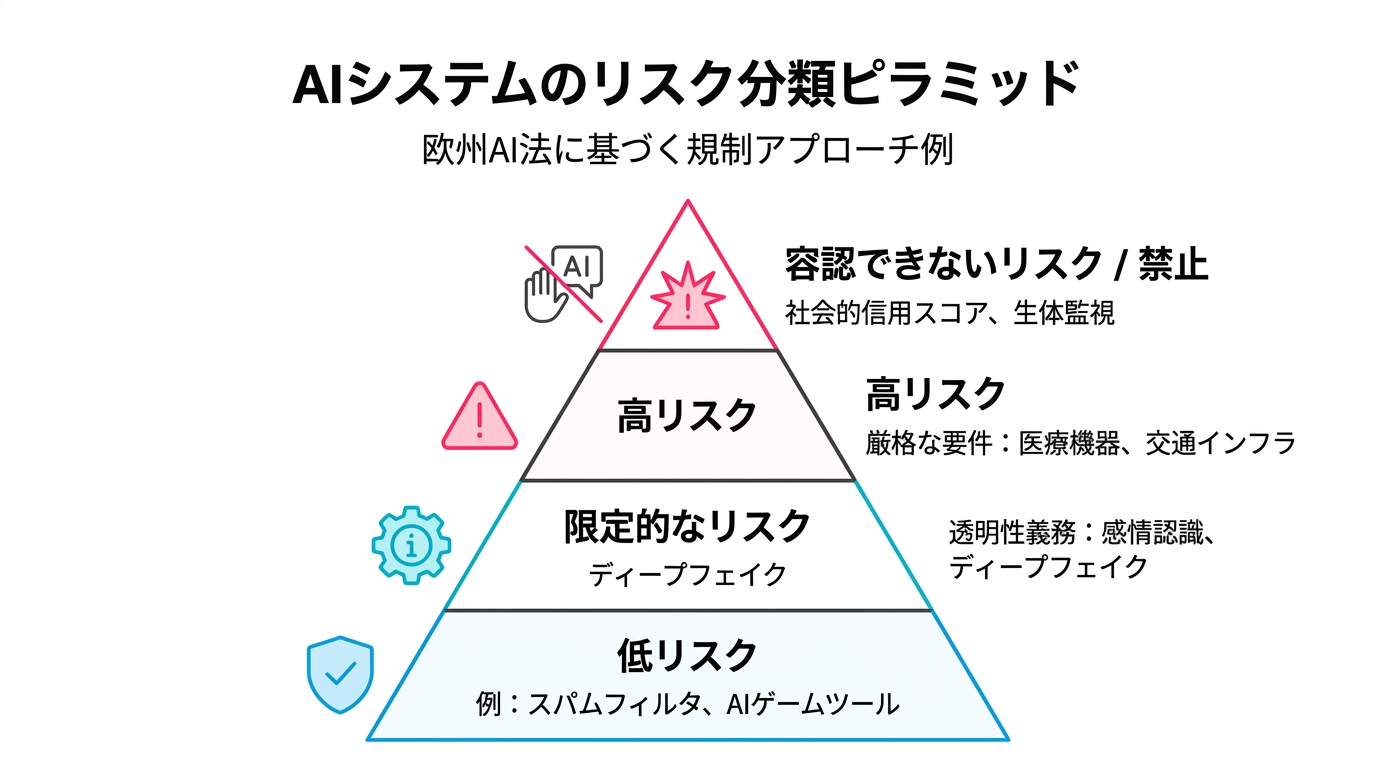

図1: EU AI Actに基づくAI用途の4段階リスク分類

押さえるべき3つの国際フレームワーク

AIコンプライアンスに関する主要なフレームワークは、性質の異なる3つが並立しています。自社の状況に応じて、どのフレームワークを優先的に参照すべきかを判断する必要があります。

EU AI Act — リスクベースの法的規制

EUが制定した世界初の包括的AI規制法です。AIシステムを4段階のリスクレベルに分類し、リスクに応じた法的義務を課します。

- 許容できないリスク(禁止): 社会的スコアリング、無差別な生体認証など。提供・利用が全面禁止

- 高リスク: 採用AI、信用評価、医療診断支援など。適合性評価、リスク管理システム、人間による監視が義務

- 限定的リスク: チャットボットなど。AIであることの開示(透明性義務)が必要

- 最小リスク: スパムフィルター、ゲームAIなど。特別な義務なし

EU圏でビジネスを行う日本企業は、自社のAI用途がどのリスクカテゴリに該当するかを把握しておく必要があります。

NIST AI RMF — 4つのコア機能で管理するガイドライン

米国国立標準技術研究所(NIST)が策定したAIリスクマネジメントフレームワークです。法的拘束力はありませんが、世界的に参照されています。4つのコア機能で構成されます。

- GOVERN(統治): 組織のAI方針と責任体制を確立する

- MAP(把握): AIの用途とリスクを特定・分類する

- MEASURE(測定): AIの性能・公平性・安全性を定量的に測定する

- MANAGE(管理): リスクへの対応策を実行し、継続的にモニタリングする

2024年7月には生成AI特有のリスクに対応した拡張プロファイルも公開されており、生成AIを業務で活用する組織にとって実務的な参考になります。

ISO/IEC 42001 — 第三者認証が可能な国際規格

2023年12月に発行された、AIマネジメントシステム(AIMS)に関する初の国際規格です。情報セキュリティのISO 27001と同様に、第三者認証を取得できます。取引先へのAIガバナンスの証明として活用できる点が特徴です。

日本のAI事業者ガイドライン

経済産業省と総務省が策定した、日本のAI事業者向けの統一的な指針です。EU AI Actが「法的義務」を課すのに対し、日本のガイドラインは「企業の自主的なガバナンス」を促すソフトロー(法的拘束力を持たない指針)です。

ただし、EU AI Actの「高リスクAI」に該当する事業を行う場合は、日本のガイドラインを遵守することがEU法対応の基礎にもなります。まずは日本のガイドラインをベースに、グローバル展開の有無に応じてEU AI ActやNIST AI RMFを組み合わせるのが実務的です。

AI用途のリスク分類 — 自社のAIはどのレベルか

フレームワークを理解したら、次は自社のAI用途を具体的に分類します。EU AI Actの4段階分類をベースに、実務でどう判断するかを見ていきましょう。

高リスクに該当しやすいAI用途

以下のような用途でAIを使っている場合、EU AI Actでは「高リスク」に分類される可能性があります。

- 採用・人事評価: 履歴書のスクリーニング、面接評価のAI支援

- 与信判断・融資審査: AIによる信用スコアリング

- 医療判断支援: 画像診断AI、治療方針の提案

- 法的判断補助: 契約書のリスク分析、法令違反の検出

これらの用途では、適合性評価、リスク管理システムの構築、人間による監視体制(Human-in-the-Loop)が義務付けられます。AI契約書レビューの導入と法的リスク管理については、AI契約書レビュー導入ガイドで詳しく解説しています。

限定的リスクに該当するAI用途

「AIが生成したコンテンツである」ことの開示が求められる用途です。

- チャットボット: 顧客対応のAIチャット

- AI生成コンテンツ: 広告文案、ブログ記事、画像のAI生成

- 文章校正・翻訳AI: レビュー業務でのAI活用

レビュー・審査業務でのAI活用は、多くの場合この「限定的リスク」に該当します。透明性義務として「AIがチェックしていること」をユーザーに開示する必要があります。

最小リスクに該当するAI用途

特別な規制義務が課されない用途です。

- スパムフィルター: メールの自動振り分け

- 議事録の自動生成: 会議内容のAI書き起こし

- 社内FAQ検索: AIによる回答候補の提示

ただし、最小リスクでも「AI事業者ガイドライン」の一般原則(安全性、透明性、公平性)は守ることが推奨されています。

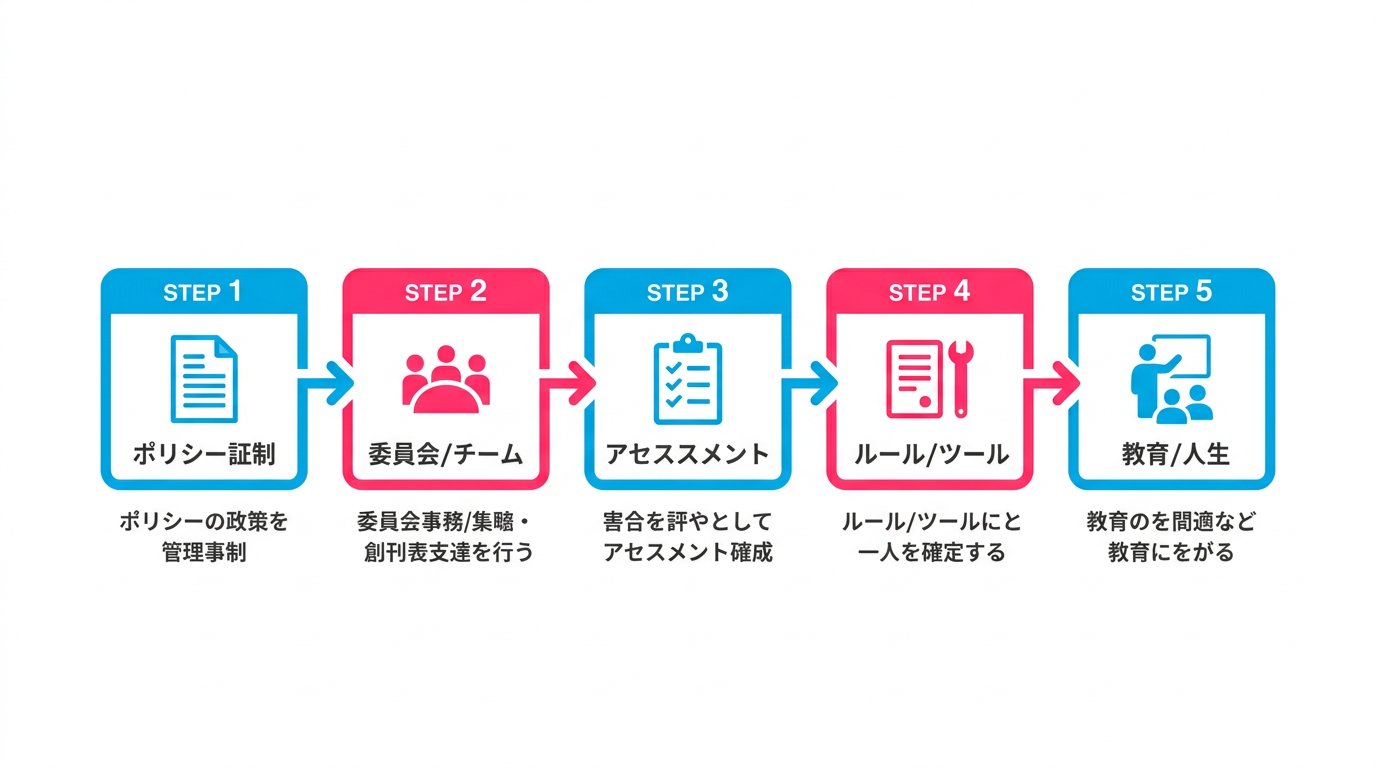

図3: AIコンプライアンス体制を構築する5ステップ

AIコンプライアンス体制を構築する5ステップ

フレームワークとリスク分類を理解したら、具体的な体制構築に移ります。以下の5ステップは、規模や業種を問わず適用できる実務手順です。

Step 1: AI基本方針(AIポリシー)の策定

経営層がコミットし、自社のAI活用方針と倫理基準を社内外に宣言します。AI基本方針には、以下の要素を含めます。

- 活用の目的と範囲: どの業務でAIを活用するか、活用しない領域はどこか

- 倫理基準: 公平性、透明性、安全性に関する自社の基本姿勢

- 禁止事項: 社会的スコアリングや差別的利用など、明確に禁止する用途

AI基本方針は社内文書にとどめず、対外的に公開することで取引先や顧客からの信頼獲得にもつながります。

Step 2: AIガバナンス委員会の設置

法務、IT、リスク管理、事業部門の横断的なメンバーで構成されるAIガバナンス委員会を設置します。この委員会がAI導入の判断、事故時の対応、規制動向のモニタリングを担います。

中小企業では独立した委員会を設けなくても、既存のリスク管理会議にAIガバナンスの議題を加える形で始められます。重要なのは「AIに関する判断の責任者」を明確にすることです。

Step 3: AI用途のリスクアセスメント

自社で利用しているAIツール・システムを棚卸しし、用途ごとにリスクレベルを評価します。

棚卸しで確認すべき項目は4つです。

- どの部門が: 利用部門と利用者数

- どのAIツールを: ツール名とバージョン、提供元

- 何の目的で: 業務上の用途と、扱うデータの種類

- どんなリスクで: EU AI Actの4段階分類でのリスクレベル

この棚卸しだけでも、「知らないうちに高リスクな使い方をしていた」「部門間でバラバラなAIツールを使っていた」といった問題が表面化します。

Step 4: 運用ルールの策定と技術的対策

リスクアセスメントの結果に基づき、具体的な運用ルールと技術的な対策を導入します。

運用ルールの具体例は次のとおりです。

- 機密情報の入力禁止: 生成AIに顧客の個人情報や社内機密を入力しない

- 出力物のファクトチェック義務化: AIの出力をそのまま使わず、必ず人間が確認する

- 利用ログの保存: 誰が、いつ、どんな入力をし、AIがどう出力したかの記録を保持する

技術的対策としては、入力フィルタリング(機密情報の検出・遮断)、出力の監査ログ、AIモデルのバージョン管理などが挙げられます。AIを活用したセキュリティ設計については、AIレビューのセキュリティ設計で詳しく解説しています。

Step 5: 全社員へのAIリテラシー教育

体制やルールを整えても、現場が理解していなければ機能しません。全社員を対象としたAIリテラシー教育を実施し、コンプライアンス意識を浸透させます。

教育で伝えるべきポイントは3つです。

- AIの限界を理解する: AIは万能ではなく、誤りも出す。出力を無批判に信用しない

- ルールの「なぜ」を伝える: 「機密情報を入れるな」だけでなく、「入力データがモデル学習に使われる可能性があるから」と理由を説明する

- 事故時の報告ルート: AIが問題のある出力をした場合、誰にどう報告するかを明確にする

属人化解消の観点からは、AIリテラシー教育も特定の担当者に依存しない設計が重要です。属人化解消の実践ガイドで教育の標準化手法を紹介しています。

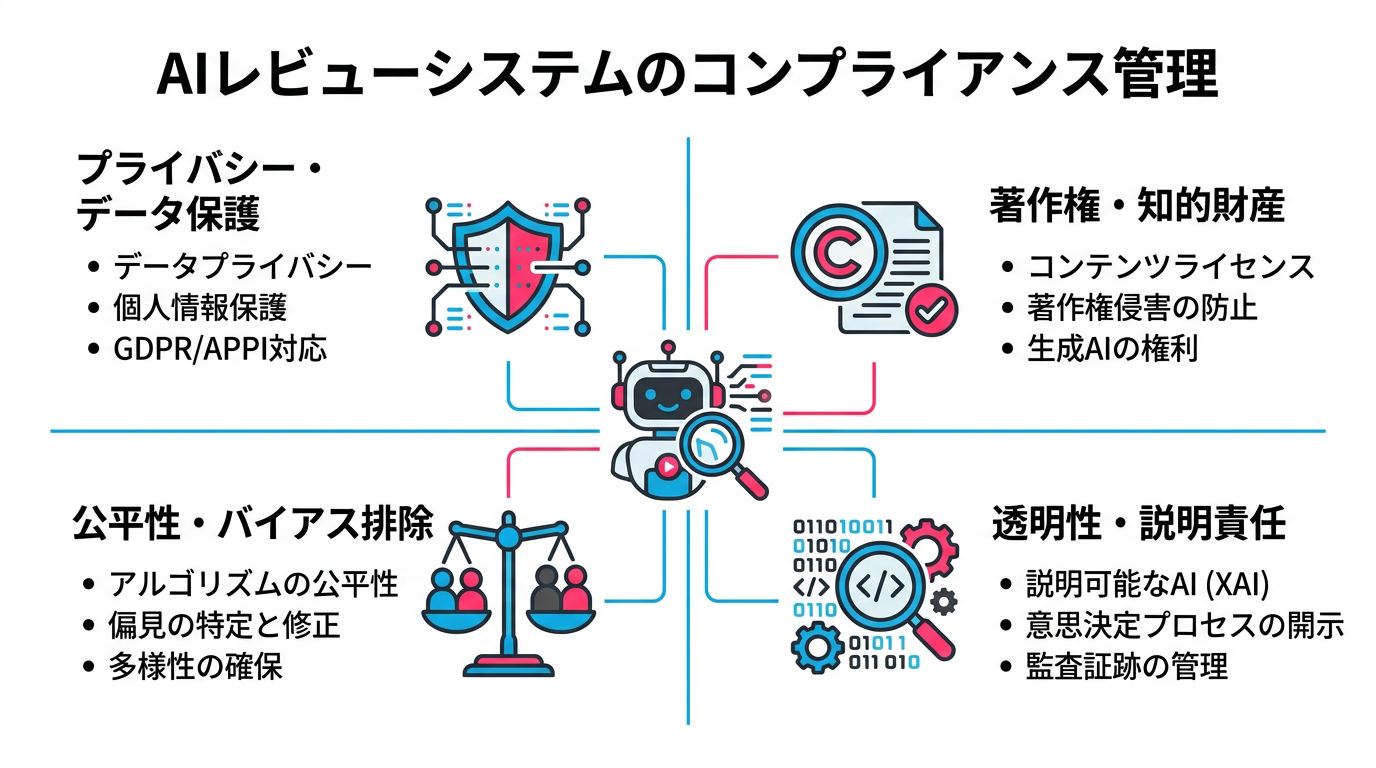

図4: レビューAIで管理すべきコンプライアンスの4領域

レビュー業務でのAIコンプライアンス実践

レビュー・審査業務でAIを活用する場合、特に注意すべきコンプライアンスの管理領域が4つあります。

プライバシー・データ保護

レビュー対象のデータに個人情報が含まれる場合、AIツールへの入力時にデータの匿名化や、データ処理の法的根拠の確認が必要です。特に外部のクラウドAIサービスを利用する場合、データがどこに保存され、どう処理されるかを確認してください。

権利侵害(著作権等)

AIが生成したレビューコメントや修正提案が、他者の著作物を無断で利用していないかの確認が必要です。また、AIの学習データに著作権のある素材が含まれていないかも、ベンダーに確認すべき事項です。

公平性・非差別

採用書類のAIレビューや、ローン申請のAI審査など、人の権利に直接影響する判断にAIを使う場合、バイアス(偏り)がないかの検証が不可欠です。性別、年齢、国籍などの属性によって判断が変わらないことを、定期的にテストする仕組みを入れましょう。

AIの判定品質を客観的に測定する方法については、AIレビューの評価指標で具体的な指標と計測手法を解説しています。

透明性・説明責任

「AIがなぜその判断をしたか」を説明できることは、規制対応だけでなく、利用者の信頼を得るためにも重要です。AIの判定結果だけでなく、判定に至った根拠や参照した情報を記録し、監査に備えます。

レビュー業務では、Human-in-the-Loop(人間による確認プロセス)の設計が鍵になります。AIが一次チェックを行い、人間が最終判断を下す体制にすることで、AIの効率とコンプライアンスの両方を実現できます。NLPを活用した自動チェックの具体的な設計については、NLPで契約書・ポリシーを自動チェックが参考になります。

よくある質問(FAQ)

中小企業でもAIコンプライアンス体制は必要ですか?

ChatGPTなどの生成AIを業務で使っているなら、規模に関わらず最低限の体制は必要です。まずはAI利用の棚卸しと、機密情報の入力禁止などの基本ルールの策定から始めてください。Step 1(AI基本方針)とStep 3(リスクアセスメント)だけでも、リスクの全体像が明確になります。

EU AI Actは日本企業にも適用されますか?

EU市場でAIサービスを提供している場合や、AIの出力がEU域内で利用される場合は域外適用の対象になります。制裁金は世界売上高の最大7%です。グローバル展開企業は自社のAI資産を棚卸しし、EU法のリスク分類に照らして対応が必要かを確認してください。

まず何から始めるべきですか?

AI事業者ガイドラインをチェックリストとして活用し、自社のAI利用状況を棚卸しすることから始めてください。どの部門が、どんなAIツールを、何の目的で使っているかを把握するだけで、リスクの全体像が見えてきます。棚卸しの結果を基に、高リスクな用途から優先的に対策を進めるのが効率的です。

コンプライアンスチェックにAIを活用する方法はありますか?

契約書や広告表現のレビューにAIを使う場合、AIの判定結果に対するHuman-in-the-Loop(人間による確認)と判定根拠の記録を組み込むことで、コンプライアンスを保ちながらAI活用の効率を得られます。AIが「問題あり」と判定した根拠を記録し、最終判断は人間が行う三層構造が実務的です。

まとめ

AIコンプライアンスは、EU AI Actの施行と日本のAI推進法成立により、すべてのAI活用企業にとって不可避のテーマになりました。以下のポイントを押さえて、体制構築を進めてください。

- フレームワークを理解する: EU AI Act(法的規制)、NIST AI RMF(ガイドライン)、ISO/IEC 42001(国際標準)、日本のAI事業者ガイドライン(ソフトロー)。まずは日本のガイドラインをベースに、グローバル展開に応じて組み合わせる

- リスク分類を実施する: 自社のAI用途を4段階で分類し、高リスク用途から優先的に対策する

- 5ステップで体制を構築する: AI基本方針→ガバナンス委員会→リスクアセスメント→運用ルール→教育。まずはStep 1とStep 3から着手する

- レビュー業務では4領域を管理する: プライバシー、権利、公平性、透明性。Human-in-the-Loopと判定根拠の記録が鍵

まずは自社のAI利用状況を棚卸しし、「どこにリスクがあるか」を把握するところから始めてください。AIコンプライアンスは「後から追いつく」よりも「最初から組み込む」方が、はるかにコストが低くなります。

この記事の著者

Naosy 編集部

レビュー・校正・審査プロセスの最適化に関する実践的なナレッジを発信しています。