審査AIの判断根拠を説明できる設計 ― XAIで現場の信頼を獲得する実装ガイド

「なぜNGと判定したのか」を説明できない審査AIは現場に定着しません。Chain-of-ThoughtやSource Attributionなど、LLM時代のXAI技術と審査UIへの実装パターンを解説します。

「AIがNGと言っているけど、理由が分からないので自分で一から確認し直しています」 ――審査AIを導入したある企業の担当者から聞いた言葉です。AIの精度がどれほど高くても、「なぜその判断に至ったか」を説明できなければ、現場の審査者はAIの結果を信頼できません。結果として、AIの判定を無視して従来通りの手作業に戻ってしまう。これが審査AIが定着しない最大の原因の一つです。

この記事では、審査AIの判断根拠を「説明できる」設計にするための技術と実装パターンを解説します。LLM時代に主流となっているChain-of-ThoughtやSource Attributionの手法から、審査UIでの表示設計、さらにEU AI Actが求める説明義務まで、実務に必要な知識を整理します。

「ブラックボックス」が審査現場で嫌われる3つの理由

AIの判断が「ブラックボックス」のままでは、審査業務で以下の3つの問題が発生します。

理由1: 審査者がAIの判定を検証できない

審査業務では、AIが「OK」と判定した文書にも最終的に人間が責任を持ちます。判断根拠が分からなければ、審査者は「本当にOKなのか」を確信できず、結局すべての文書を自分でチェックし直すことになります。AIを導入した意味がなくなるのです。

理由2: 誤判定の原因を特定できない

AIが誤った判定を出した場合、「なぜ間違えたのか」が分からなければ改善のしようがありません。AI審査モデルの評価指標で解説しているように、精度・再現率・F1スコアで「どのくらい間違えるか」は測定できますが、説明可能性がなければ「なぜ間違えるか」は特定できません。

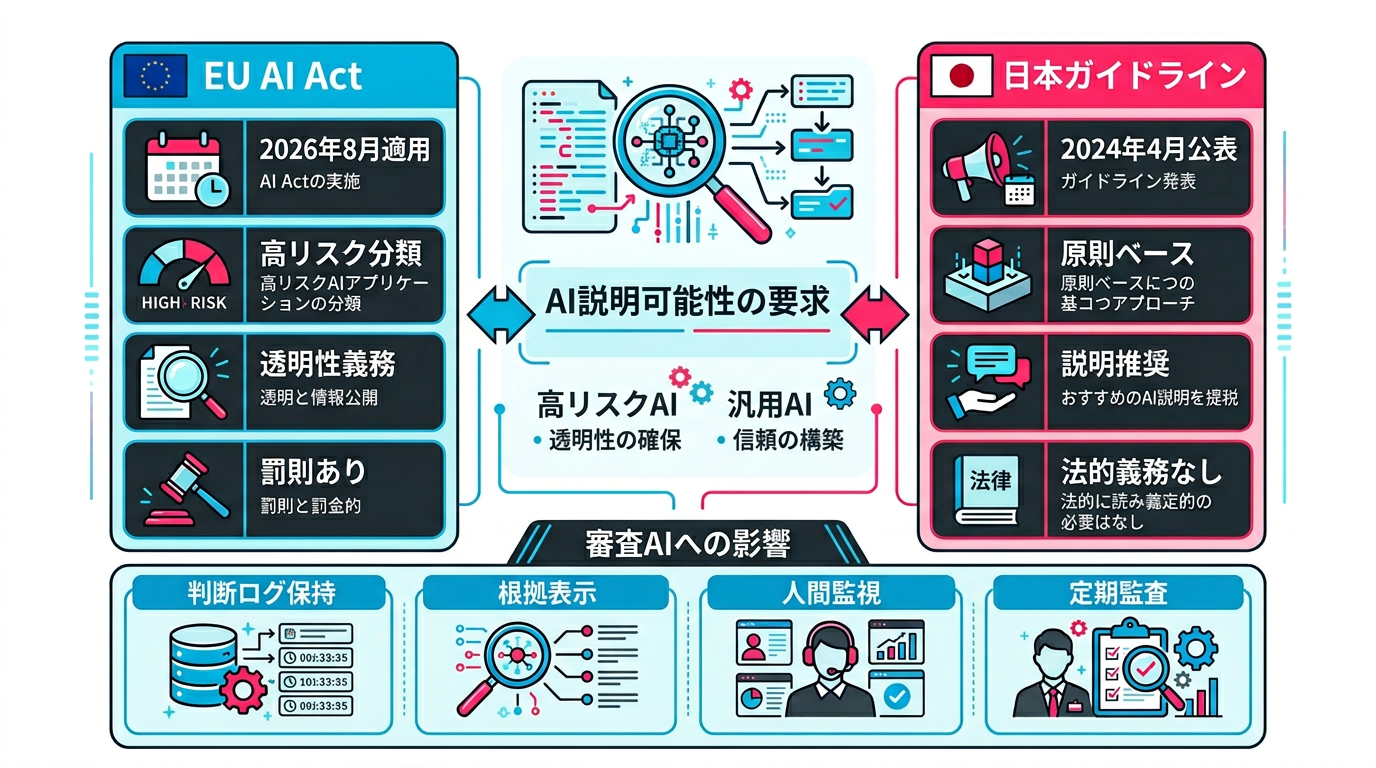

理由3: 規制当局への説明責任を果たせない

金融、医療、製薬などの規制業界では、AIの判断に対する説明責任が法的に求められるケースが増えています。EU AI Act(2024年8月発効、2026年8月本格適用)では、高リスクAIシステムに対して透明性義務を課しています。日本でも経済産業省の「AI事業者ガイドライン」(2024年4月公表)がAIの説明可能性を推奨しています。

説明可能性は「精度と同等に重要」

私たちの経験では、審査AIの導入成否を分けるのは「精度」よりも「説明可能性」です。精度95%のブラックボックスAIより、精度90%でも判断根拠を明示できるAIの方が、現場に定着する確率が圧倒的に高くなります。

LLM時代のXAI ― Chain-of-ThoughtとSource Attributionが主流に

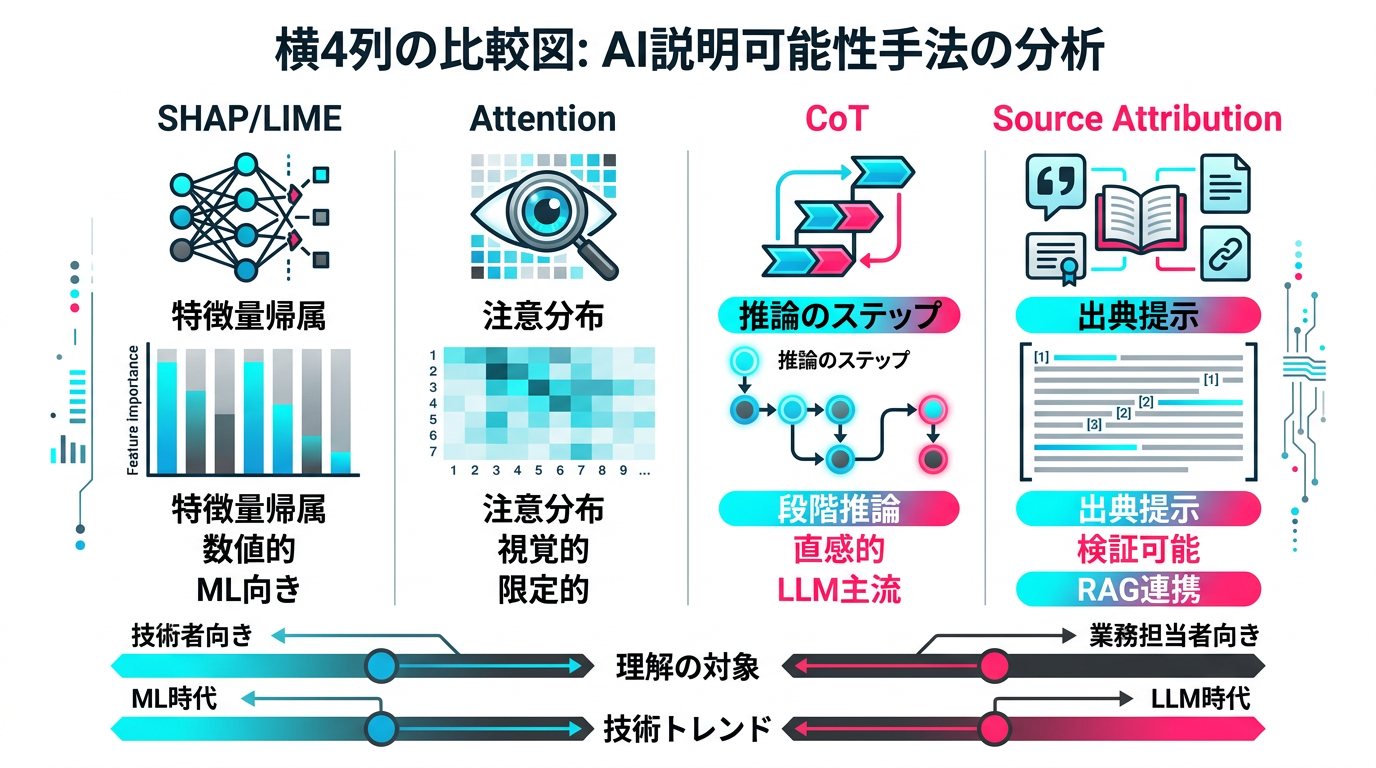

XAI(Explainable AI、説明可能なAI)の技術は、従来のSHAPやLIMEからLLM時代のCoTとSource Attributionへと大きくシフトしています。

従来のXAI手法:SHAPとLIME

SHAP(SHapley Additive exPlanations)は、各入力特徴量がAIの出力にどれだけ影響したかを数値で示す手法です。LIME(Local Interpretable Model-agnostic Explanations)は、個別の判定に対してローカルな近似モデルを構築し、判断の理由を推定します。

これらの手法は従来の機械学習モデルには有効ですが、LLMに対しては限界があります。LLMの入力は「テキスト全体」であり、「どの単語が判断に影響したか」を示すだけでは、審査者にとって分かりやすい説明にはなりません。

CoT(Chain-of-Thought):段階的推論による説明

LLM時代のXAIで最も実用的なのが、CoT(Chain-of-Thought、段階的推論)による説明です。LLMに「判断のプロセスをステップごとに記述してください」と指示するだけで、人間が読める形の推論過程が得られます。

審査AIでCoTを使う場合のプロンプト設計のポイントは以下です。

- 判断ステップを明示させる: 「まずチェック基準Aに照合し、次にチェック基準Bを確認し…」という手順を出力させる

- 根拠となる箇所を引用させる: 「この判断の根拠は、文書の第3段落『○○○』という記述です」と元テキストを引用させる

- 確信度を付与させる: 「高確信」「中確信」「低確信」のラベルを判定ごとに付けさせ、確信度が低い項目を人間が優先的に確認する

Source Attribution:根拠の出典を明示する

Source Attribution(根拠の出典提示)は、AIの判断がどの情報源に基づいているかを明示する手法です。RAGで審査基準を最新に保つ仕組みを使う場合、AIが参照した審査基準のドキュメント名、ページ番号、該当箇所を判定結果と一緒に表示します。

Source Attributionの利点は、審査者が「AIの判断根拠が正しいか」を元の資料に遡って検証できることです。LLMのハルシネーション対策の観点からも、根拠を明示させることでAIの「嘘」を検出しやすくなります。

図2: XAI手法の比較 ― ML時代からLLM時代への進化

図2: XAI手法の比較 ― ML時代からLLM時代への進化

審査UIでの説明表示設計 ― 4つのパターン

XAI技術で生成した説明を、審査者が使うUIにどう表示するかは、現場の使いやすさを大きく左右します。私たちが推奨する4つの表示パターンを紹介します。

パターン1: ハイライト型

文書中の問題箇所を色付きでハイライトし、該当箇所にマウスを合わせるとAIの指摘理由がツールチップで表示される方式です。審査者が文書を読みながら自然にAIの指摘を確認できるため、最も直感的なパターンです。

パターン2: サイドパネル型

画面を左右に分割し、左側に審査対象の文書、右側にAIの判定結果と根拠を一覧表示する方式です。複数の指摘を俯瞰的に確認でき、指摘の優先順位付けもしやすくなります。

パターン3: ステップ解説型

AIの推論過程をステップごとに展開表示する方式です。「ステップ1: 表現Aをチェック → 問題なし → ステップ2: 表現Bをチェック → NGリストに該当」というように、判断のプロセスを追跡できます。CoT方式の出力をそのまま活用できるため、実装コストが低いのが利点です。

パターン4: 根拠引用型

AIの判定結果に対して、根拠となった審査基準やルールの原文を引用形式で表示する方式です。「この判定は、審査基準書v3.2の第5条3項『○○は禁止表現とする』に基づいています」のように、トレーサビリティ(追跡可能性)を確保できます。

私たちが推奨するのは、ハイライト型 + サイドパネル型の組み合わせです。日常的なチェックではハイライト型で素早く問題箇所を把握し、判断に迷うケースではサイドパネルで詳細な根拠を確認する。この二段構えが、審査のスピードと正確性を両立させます。

規制対応と説明義務 ― EU AI Actと日本のガイドライン

審査AIの説明可能性は、技術的な選択を超えて、法的・規制的な義務になりつつあります。

EU AI Act(AI規制法)の要件

EU AI Act(2024年8月発効)は、AIシステムをリスクレベルで分類し、高リスクシステムには厳格な透明性義務を課しています。2026年8月から本格的に適用されます。

審査AIが「高リスク」に分類される可能性があるのは、以下のケースです。

- 金融サービスにおける信用審査やリスク評価

- 雇用・採用に関する書類審査

- 公的機関による申請審査

高リスクAIに分類された場合、「AIの判断のロジック、主要なパラメータ、その判断の正確性のレベルについて、利用者が理解できる形で情報を提供する」ことが義務づけられます。

日本のガイドライン

日本では法的拘束力のあるAI規制法はまだ整備途上ですが、経済産業省の「AI事業者ガイドライン」(2024年4月公表)が、AIの透明性と説明可能性を「望ましい原則」として位置づけています。金融庁も「AIの活用に関するガイドライン」で、AIの判断根拠の説明を求めています。

AIコンプライアンス体制の構築で解説しているように、規制対応は「義務化されてから急いで対応する」のではなく、設計段階から織り込むことで、後からの手戻りを防げます。

図4: EU AI Actと日本のAIガイドラインにおける説明義務の比較

図4: EU AI Actと日本のAIガイドラインにおける説明義務の比較

まとめ

審査AIの説明可能性は、精度と同等に重要な設計要素です。「なぜその判定に至ったか」を説明できるAIは、現場に定着し、継続的に改善される好循環を生みます。

- LLM時代はCoTとSource Attributionが主流: SHAPやLIMEに代わり、プロンプト設計で実現できる説明手法がLLM時代の標準に

- UIは「ハイライト+サイドパネル」の組み合わせを推奨: 日常的な確認とじっくり検証の両方をカバー

- 確信度ラベルで人間の確認範囲を最適化: 「高確信」の判定はスキップ、「低確信」の判定を重点的にレビュー

- 規制対応は設計段階から織り込む: EU AI Actの高リスク分類に備え、判断ログの保持と根拠表示を最初から実装

次のアクションとして、自社の審査AIの判定結果が「理由なし」で返っていないかを確認してください。CoTプロンプトの追加は数行の変更で実現でき、審査者の信頼度向上に即効性があります。

よくある質問(FAQ)

XAI(説明可能AI)とは何ですか?

XAI(Explainable AI)とは、AIの判断理由や根拠を人間が理解できる形で提示する技術の総称です。審査AIの場合、「なぜこの文書をNGと判定したのか」を具体的な根拠とともに説明できることを指します。

LLMの説明可能性はどう実現しますか?

LLMではChain-of-Thought(段階的推論)とSource Attribution(根拠の引用提示)が主流です。プロンプトで「判断理由をステップごとに説明してください」と指示するだけで、従来のSHAPやLIMEより直感的な説明が得られます。

EU AI Actで審査AIにはどんな説明義務がありますか?

EU AI Act(2026年8月本格適用)では、高リスクAIシステムに透明性義務が課されます。審査AIが「高リスク」に分類される場合、判断の根拠を利用者に説明できる仕組み、ログの保持、人間による監視体制が必要です。

説明機能を追加するとAI審査は遅くなりますか?

Chain-of-Thought方式では出力トークンが増えるため、処理時間は20〜30%程度長くなります。ただし、審査者が結果を確認する時間は大幅に短縮されるため、審査ワークフロー全体では時間短縮になるケースがほとんどです。

この記事の著者

Naosy 編集部

レビュー・校正・審査プロセスの最適化に関する実践的なナレッジを発信しています。