生成AI導入の進め方 ― 審査業務で失敗しない5段階ステップとチェックリスト

生成AI導入プロジェクトの7割が期待した成果を出せない原因と、審査業務で成功するための5段階導入モデルを解説。業務の棚卸しからPoC、本番展開まで具体的なチェックリストと判断基準を紹介します。

「生成AIを導入したい。でも、何から手を付ければいいのか分からない」――私たちが支援する企業の8割以上が、最初にこの悩みを口にします。 2025年後半から2026年にかけて、Claude 4やGPT-5といった大規模言語モデルが急速に進化し、「うちもそろそろ」という声が社内で上がっている企業は多いのではないでしょうか。

しかし、生成AI導入プロジェクトの多くは期待した成果にたどり着けていません。総務省の「令和6年版 情報通信白書」によれば、日本企業のAI導入率は約25%にとどまり、導入企業の中でも「十分な成果が出ている」と回答した企業は半数以下です。技術の問題ではなく、導入の進め方に原因があるケースがほとんどです。

この記事では、審査・レビュー業務に生成AIを導入するための5段階モデルと、各段階で失敗しないためのチェックリストを紹介します。

なぜ生成AI導入の多くは期待した成果を出せないのか

生成AI導入が空回りする原因は、技術選定の失敗ではありません。私たちが見てきた中で最も多い失敗パターンは3つあります。

失敗パターン1: 「何に使うか」を決めずにツールを導入する

「とりあえずChatGPTの法人プランを契約した」「Copilotを全社導入した」――こうしたケースでは、ツールは入ったものの現場で使われないまま終わることが少なくありません。ツール導入が目的化し、「どの業務のどの工程で使うか」が曖昧なままだと、現場は使い方が分からず放置します。

失敗パターン2: いきなり大きく始める

「全社で一斉に導入する」「複数の業務を同時にAI化する」――スケールの大きさが仇になるパターンです。生成AIの出力品質は業務によって大きく異なるため、一度に複数業務を対象にすると、どこでうまくいっていてどこで問題が起きているかの切り分けができません。

失敗パターン3: 現場を巻き込まない

IT部門やDX推進室だけでプロジェクトを進め、実際に業務を行う現場担当者を巻き込まないケースです。生成AIの精度は「どんなチェック基準を教えるか」で決まるため、業務の暗黙知を持つ現場担当者の関与なしには実用レベルの仕組みは作れません。

導入失敗の根本原因

生成AI導入で最も重要なのは、技術選定でもツール選定でもなく「対象業務の選定」です。AIが得意な業務とそうでない業務の見極めが、プロジェクト成否の8割を決めます。

審査業務向け生成AI導入の5段階モデル

私たちは、審査・レビュー業務への生成AI導入を支援する中で、成功する企業に共通するアプローチを「5段階導入モデル」として整理しました。このモデルの特徴は、各段階に明確な判断基準(Go/No-Go条件)を設けている点です。

Phase 1: 業務棚卸し(2〜3週間)

最初にやるべきことは、対象となる審査業務の全体像を可視化することです。多くの企業がこのステップを軽視しますが、ここでの精度がプロジェクト全体の成否を左右します。

具体的には、審査業務を「入力」「チェック項目」「判断基準」「出力」の4要素に分解します。たとえば広告審査であれば、入力は「広告原稿」、チェック項目は「薬機法NG表現の有無」「景表法の優良誤認チェック」、判断基準は「NGリスト照合」「文脈による判断」、出力は「OK/NG判定と修正指示」です。

この分解が重要な理由は、生成AIが得意な領域と不得意な領域を見極めるためです。チェック項目が明文化されていて判断基準がルール化されている業務ほど、AIの精度が出やすくなります。逆に「経験と勘」で判断している業務は、AIの導入難度が高くなります。

Phase 2: 設計・ツール選定(2〜3週間)

棚卸しの結果をもとに、「AI化する範囲」と「人間が担当する範囲」を明確に線引きします。ここで重要なのは、全体を一度にAI化しようとしないことです。

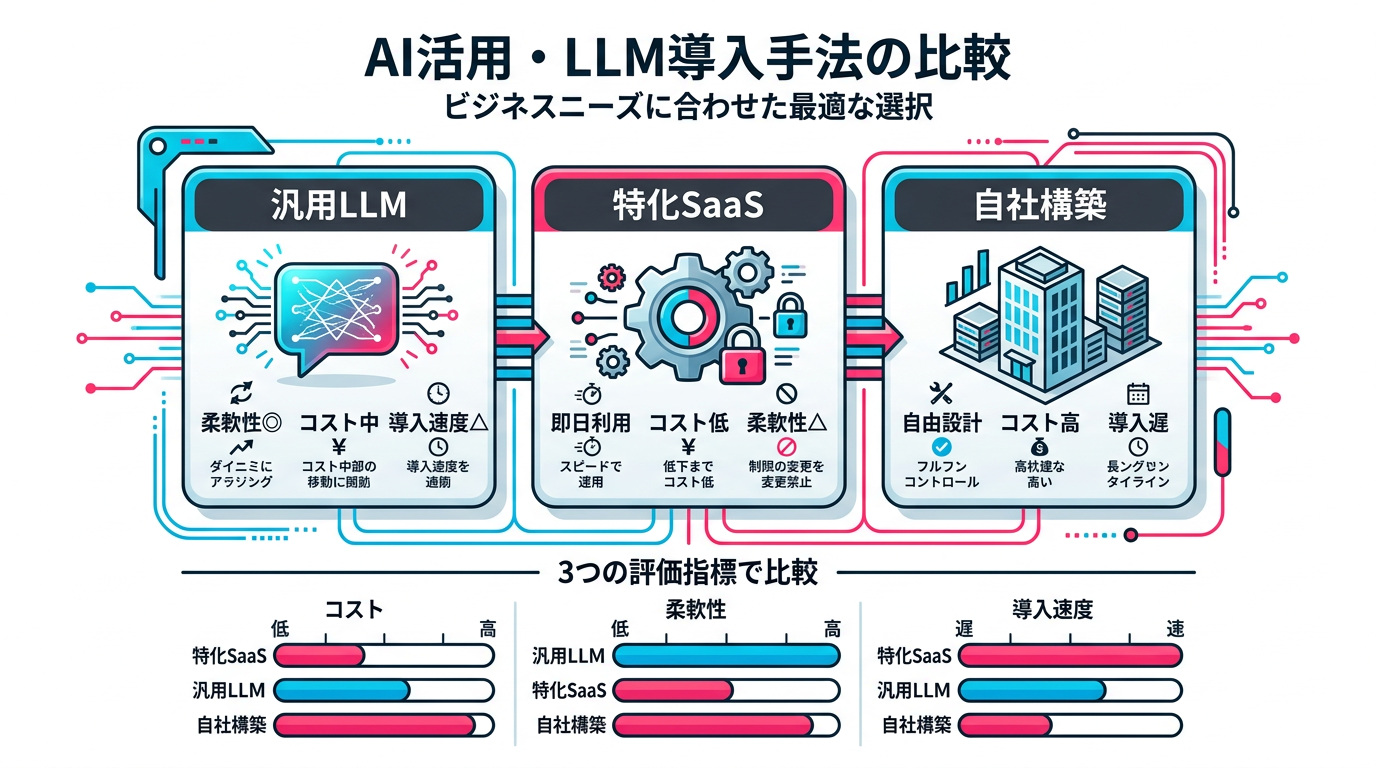

2026年現在、審査業務で使える生成AIツールは大きく3つのカテゴリに分かれます。

- 汎用LLMサービス: ChatGPT Enterprise、Claude for Business、Gemini for Google Workspaceなど。API連携でカスタマイズが可能

- 業務特化型SaaS: LegalForce(契約書審査)、薬事チェッカー(薬機法チェック)など。初期設定が簡単で即日利用可能

- 自社構築型: Azure OpenAI Service、Amazon Bedrockなどを使ったカスタムソリューション。柔軟性が高いが構築コストも高い

どのカテゴリを選ぶかは、Phase 1で明らかになった業務の特性と、社内のIT体制で決まります。生成AIの業務活用パターンで解説している5つのパターンを参考に、自社の審査業務に最適なアプローチを選んでください。

図2: ツール選定の3カテゴリ比較

Phase 3: PoC(概念実証)の実施(1〜2ヶ月)

設計が固まったら、小規模なパイロットで効果を検証します。PoCで検証すべきことは「精度」「速度」「現場の受容度」の3つです。

PoCの対象は、月間処理件数が50件以上あり、チェック基準が明文化されている業務を選びます。件数が少なすぎると統計的に有意な結果が得られず、判断基準が曖昧だとAIの精度評価ができません。

PoCの評価指標は以下の4つを事前に設定します。

- 精度: AIの検出率と誤検出率。人間のチェック結果との一致率85%以上が最低ライン

- 処理時間: 1件あたりの処理時間が従来の手作業と比べて50%以上短縮されるか

- 現場評価: 実際に使う担当者からのフィードバック。「使いたい」と思えるか

- コスト: 月額のAPI利用料と人件費削減効果の比較

PoCの成功基準を事前に決める

PoCの最大の失敗は「何をもって成功とするか」を決めずに始めることです。上記4指標の合格ラインを事前にプロジェクトオーナーと合意しておくことで、PoC後の判断がブレなくなります。

Phase 4: 本番展開(1〜2ヶ月)

PoCで成果が確認できたら、本番環境への展開に移ります。ここでのポイントは「段階的ロールアウト」です。

まず対象チーム(5〜10名程度)に限定して展開し、運用上の課題を洗い出します。よくある課題は「AIの出力結果をどう確認するか」「AIが判断できない例外ケースをどうエスカレーションするか」の2点です。

本番展開では、AIコンプライアンス体制の構築ガイドで解説しているような、AI利用に関する社内ルールの整備も必要です。とくに審査業務では「AIの判断を最終判断としてよいか」という権限設計が重要になります。2026年4月に施行予定のEU AI規制法(EU AI Act)では、「高リスクAIシステム」に該当する場合、人間による監視義務が明文化されています。日本でも経済産業省の「AI事業者ガイドライン」(2024年4月公表)に沿った運用設計が求められます。

Phase 5: 最適化と横展開(継続的)

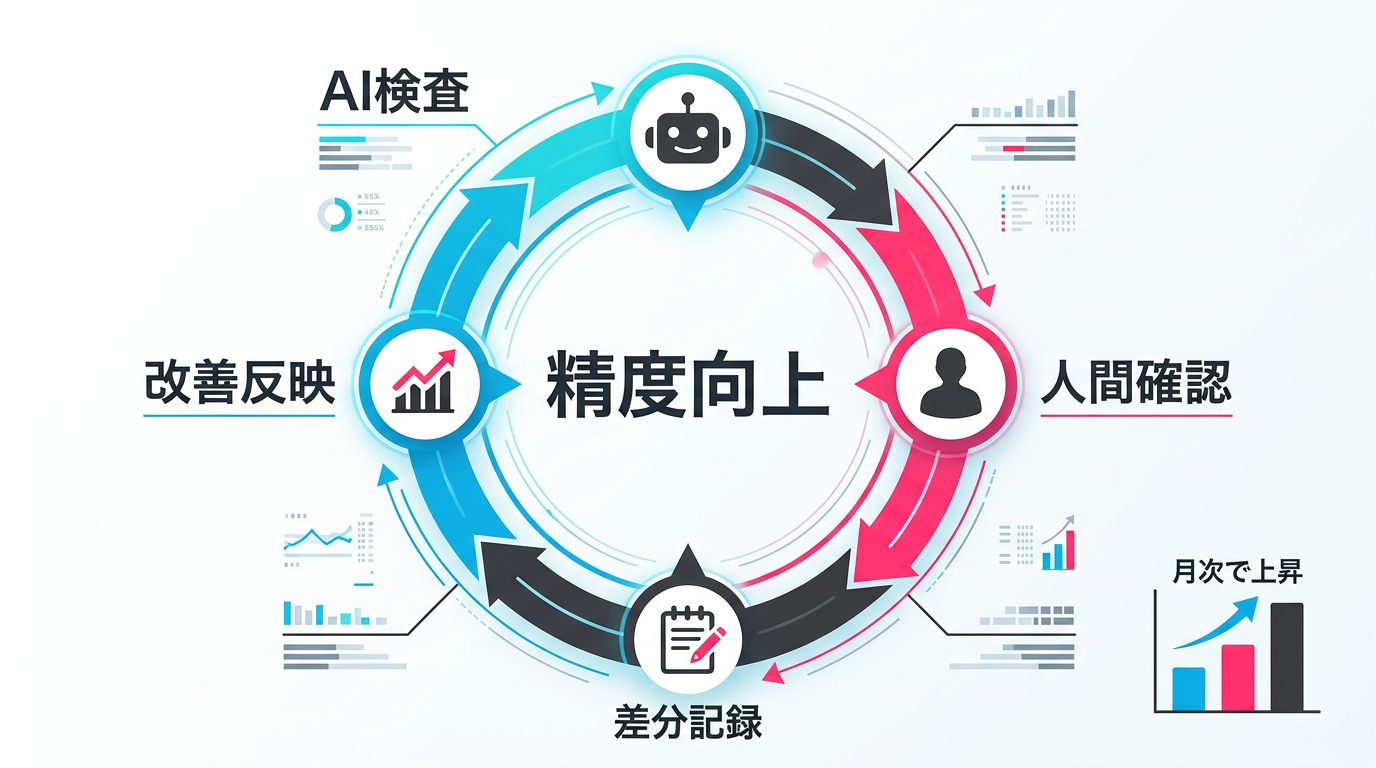

本番運用が安定したら、継続的な精度改善と他業務への横展開を進めます。

精度改善の鍵は「フィードバックループ」の構築です。AIが見逃したチェック漏れや、逆にAIが過剰に検出した誤検出のデータを蓄積し、プロンプトやルールの調整に活用します。私たちの経験では、このフィードバックループを月次で回すだけで、3ヶ月後には精度が10〜15ポイント向上するケースが多いです。

横展開では、Phase 1の業務棚卸しで「AI適合度スコア」が高かった次の業務に展開します。最初の業務で得たノウハウ(プロンプト設計のコツ、運用ルールのテンプレートなど)を横展開用の「導入キット」として整備しておくと、2つ目以降の導入スピードが大幅に上がります。AI導入事例まとめで紹介している成功企業は、いずれもこの「横展開の仕組み化」を実践しています。

図3: フィードバックループによる継続的な精度改善

審査業務のAI適合度を判定する方法

「自社の審査業務に生成AIが使えるかどうか」を判断するために、私たちは「AI適合度スコアリング」というフレームワークを使っています。5つの評価軸で業務をスコアリングし、合計点で導入の優先度を決めます。

評価軸1: チェック基準の明文化度(0〜4点)

審査基準がドキュメント化されているか。口頭伝承だけなら0点、完全にマニュアル化されていれば4点です。

評価軸2: 判断の定型度(0〜4点)

チェック結果がOK/NGの二値で判定できるか。グレーゾーンの判断が多い業務ほど点数が低くなります。

評価軸3: 処理件数(0〜4点)

月間処理件数が多いほど、AI導入の投資対効果が高くなります。月10件未満なら0点、100件以上なら4点です。

評価軸4: 現在の工数(0〜4点)

1件あたりの処理に30分以上かかる業務は、AI導入による時間削減効果が大きくなります。

評価軸5: エラー影響度(0〜4点)

チェック漏れが発生したときのビジネスインパクト。法令違反や重大事故につながる業務は、AIによる網羅的チェックの価値が高い反面、精度要件も厳しくなります。

合計点が16点以上なら「すぐに導入を開始すべき」、12〜15点なら「PoCで検証する価値あり」、11点以下なら「他の業務を優先」と判断します。

このスコアリングを社内の主要な審査業務すべてに実施し、スコアが高い順に導入を進めることで、限られたリソースで最大の効果を得られます。

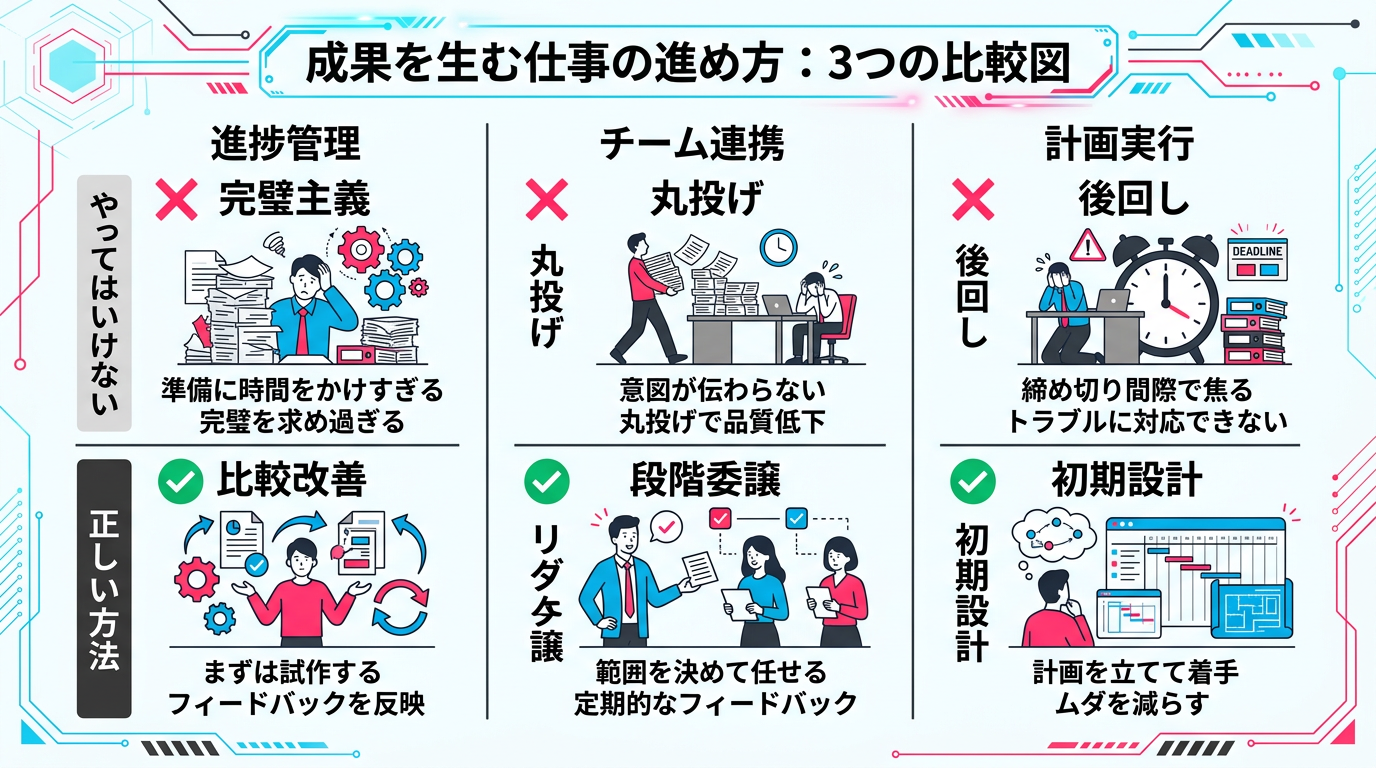

導入で失敗しないための3つの「やってはいけない」

5段階モデルの各フェーズで押さえるべきポイントに加え、導入全体を通じて避けるべき3つの落とし穴を紹介します。

やってはいけない1: AIに100%の精度を求める

「AIの精度が100%になるまで導入は見送る」――この判断は合理的に見えて、実は導入が永遠に進まない原因になります。人間のチェックでも100%の精度は実現できません。重要なのは「AIのチェック精度が、現状の人間のチェック精度と比べてどうか」という比較です。

たとえば、現在の人間によるダブルチェックの見逃し率が5%だとします。AIの一次チェックの見逃し率が3%で、その後に人間が確認するフローなら、全体の見逃し率は大幅に下がります。DXでレビュープロセスを変革する方法でも触れているように、「完璧」ではなく「改善」を基準にすることが、導入の現実的な判断軸です。

やってはいけない2: 現場に「AI任せ」を強制する

「AIがOKと言ったら承認してください」と現場に指示するのは逆効果です。現場担当者はAIの判断に対する信頼がまだ醸成されていない段階で、責任だけを押しつけられると感じます。

導入初期は「AIの出力を参考情報として表示し、最終判断は人間が行う」というアシストモードからスタートします。現場がAIの精度を体感し、信頼が醸成されてから、段階的にAIの判断権限を拡大していくのが正しい順序です。

やってはいけない3: セキュリティの検討を後回しにする

審査業務では機密情報を扱うケースが多いため、生成AIに送信するデータの取り扱いは導入初期から検討が必要です。外部のLLMサービスに社内文書を送信してよいのか、個人情報のマスキングは必要か、監査ログは取得できるか――これらの検討を後回しにすると、PoCが成功しても本番展開で頓挫します。

AI審査のセキュリティ設計で解説しているアーキテクチャパターンを参考に、データの機密レベルに応じた対策を最初から設計に組み込んでください。

図4: 導入で失敗しないための3つの「やってはいけない」

2026年の生成AI導入で押さえるべき技術トレンド

生成AI導入を検討する際に、2026年時点の技術動向を理解しておくことで、ツール選定の精度が上がります。

トレンド1: エージェント型AIの実用化

2025年後半から、AIが単にテキストを生成するだけでなく、複数のツールを自律的に操作する「AIエージェント」が実用段階に入っています。Claude Agent TeamsやOpenAI Agents SDKなどのフレームワークにより、「文書を受け取る → チェック基準と照合 → 問題箇所を特定 → 修正案を提示 → 承認フローに回す」という一連の審査ワークフローを、AIが自律的に実行できるようになっています。

AIエージェントで審査業務はどう変わるかで詳しく解説していますが、審査業務はAIエージェントとの相性が非常に良い領域です。チェック基準が明確で、判断の分岐条件が定義でき、ツール連携(メール送信、スプレッドシート更新、承認システム操作)が必要な業務は、エージェント型AIの最適な適用先です。

トレンド2: MCPによるツール連携の標準化

MCP(Model Context Protocol)は、AIモデルと外部ツールをつなぐための標準プロトコルです。従来はAIとツールの連携には個別のAPI開発が必要でしたが、MCPにより「AI ↔ 社内システム」の接続がプラグイン感覚で実現できるようになりました。

これにより、既存の文書管理システムやワークフロー管理ツールとAIを連携させるハードルが大幅に下がっています。

トレンド3: マルチモーダル対応の進化

2025年以降のLLMは、テキストだけでなく画像・PDF・表組みなどを直接読み取って処理できるようになっています。これにより、「紙の文書をスキャンしてAIにチェックさせる」「広告のクリエイティブ画像をAIに審査させる」といった、従来はOCRの前処理が必要だった業務にも生成AIが直接対応できるようになりました。

まとめ

生成AI導入プロジェクトの成否は、技術選定よりも「導入の進め方」で決まります。審査業務向け5段階導入モデルに沿って、確実にステップを踏むことが成功の鍵です。

- Phase 1(棚卸し): 業務を「入力・チェック項目・判断基準・出力」の4要素に分解し、AI適合度をスコアリングする

- Phase 2(設計): 汎用LLM・業務特化SaaS・自社構築の3カテゴリからツールを選定する

- Phase 3(PoC): 精度・処理時間・現場評価・コストの4指標で効果を検証する

- Phase 4(本番展開): 段階的ロールアウトで運用課題を洗い出し、社内ルールを整備する

- Phase 5(最適化): フィードバックループで精度を継続改善し、横展開を仕組み化する

次のアクションとして、まず自社の審査業務を1つ選び、AI適合度スコアリングの5軸で評価してみてください。合計16点以上の業務があれば、生成AI導入の第一歩を踏み出す準備が整っています。

よくある質問(FAQ)

生成AI導入にはどのくらいの期間がかかりますか?

業務の複雑さにより異なりますが、パイロットで3ヶ月、本番展開まで含めて6〜9ヶ月が目安です。最初の1ヶ月で業務棚卸しとツール選定を行い、2〜3ヶ月目でPoCを実施するスケジュールが一般的です。ただし、Phase 1の業務棚卸しの段階で「チェック基準が明文化されていない」ことが分かった場合は、基準の整備に1〜2ヶ月の追加期間が必要です。

生成AI導入に必要な社内体制は?

最低限必要なのは、業務を理解している現場担当者、IT部門の技術担当者、導入の意思決定ができるマネジメント層の3者です。専任チームでなくても、兼務で週に数時間のコミットメントがあれば進められます。PoC段階で外部のAIコンサルティング企業と連携することも有効です。

生成AIの導入費用はどのくらいですか?

クラウド型のAIサービスであれば月額数万円から始められます。API連携で自動化する場合は初期構築費用が数十万〜数百万円程度かかりますが、パイロットの段階では既存のSaaS型サービスで十分です。ROIの観点では、月間処理件数×1件あたりの時間削減×時間単価で投資回収期間を算出し、6ヶ月以内に回収できる見込みがあれば導入に踏み切る判断基準として妥当です。

審査業務以外にも同じ導入ステップは使えますか?

基本的な5段階モデルはどの業務にも適用できます。ただし審査業務はチェック基準が明文化しやすく、効果測定も定量化しやすいため、生成AI導入の最初のターゲットとして特に適しています。他の業務(営業資料作成、議事録要約、問い合わせ対応など)に展開する際も、Phase 1のAI適合度スコアリングが有効です。

この記事の著者

Naosy 編集部

レビュー・校正・審査プロセスの最適化に関する実践的なナレッジを発信しています。