AI PoCの進め方 ― 審査業務で3ヶ月以内に成果を出す実践ガイド

AI PoCの7割が本番化できずに終わる原因と、審査業務で3ヶ月以内に成果を出すPoC設計の方法を解説。準備・実験・評価・判断の4フェーズで進めるタイムラインと、Go/No-Goの判断基準を具体的に紹介します。

「PoCまでは成功したのに、その先に進めない」――AI導入プロジェクトで最もよく聞く悩みの一つです。 ガートナーの調査によれば、AI PoCの約半数は本番運用にスケールできずに終わっています。「PoC疲れ」という言葉が生まれるほど、PoCの繰り返しに疲弊している企業は少なくありません。

しかし、本番化できないPoCの多くは、やり方に問題があります。ゴールが曖昧なまま始めている、評価基準を事前に決めていない、対象業務の選び方が間違っている――原因はたいてい「PoCの設計」にあります。

この記事では、審査・レビュー業務に特化したAI PoCの進め方を、3ヶ月のタイムラインで具体的に解説します。PoCを「やって終わり」にせず、本番化への道筋をつけるための判断基準も含めてカバーします。

PoCが本番化できない3つの構造的原因

AI PoCが本番化に至らない原因は、技術的な問題よりもプロジェクト設計の問題であることがほとんどです。

原因1: 「AIの可能性を探る」がゴールになっている

「AIで何ができるか試してみよう」というゴール設定は、PoCの最大の落とし穴です。このゴールでは、何をもって成功とするかの判断基準がないため、PoCが終わっても「面白い結果は出たが、事業判断ができない」という状態に陥ります。

正しいゴール設定は、ビジネス課題から逆算した具体的な問いの形をとります。「広告審査の一次チェックをAIで代替し、審査工数を50%削減できるか?」「契約書の必須条項チェックのAI検出率は、現在の人手チェックの精度(95%)を上回れるか?」のように、検証すべき仮説を明確にします。

原因2: 本番環境とかけ離れた条件で検証している

PoCではうまくいったのに本番で精度が出ない――この「PoC詐欺」と呼ばれる問題は、PoCの実験条件が本番環境と異なることが原因です。

よくあるパターンは、PoCでは整形済みのきれいなデータだけを使い、本番では手書きやフォーマットがバラバラのデータが入ってくるケースです。また、PoCでは技術に詳しいメンバーが操作し、本番では現場の一般社員が使うことで、使い方の違いによる精度低下が起きることもあります。

原因3: 本番化のコストとリスクを見積もっていない

PoCの段階で「本番化したらどのくらいのコストがかかるか」「どんなリスクがあるか」を見積もっていないと、PoC成功後の意思決定が止まります。「PoCの月額コストは5万円だったが、本番化するとセキュリティ対策やシステム連携で初期費用500万円かかる」と分かった時点で、経営層がストップをかけるケースは珍しくありません。

PoCの設計段階で、本番化に必要な追加投資の概算を出しておくことが重要です。

3ヶ月PoCタイムライン: 4フェーズの進め方

私たちは審査業務のAI PoCを「準備・実験・評価・判断」の4フェーズに分け、3ヶ月のタイムラインで進めるフレームワークを使っています。

フェーズ1: 準備(1ヶ月目の前半)

やること: ゴール定義、評価指標設計、データ準備、ツール選定

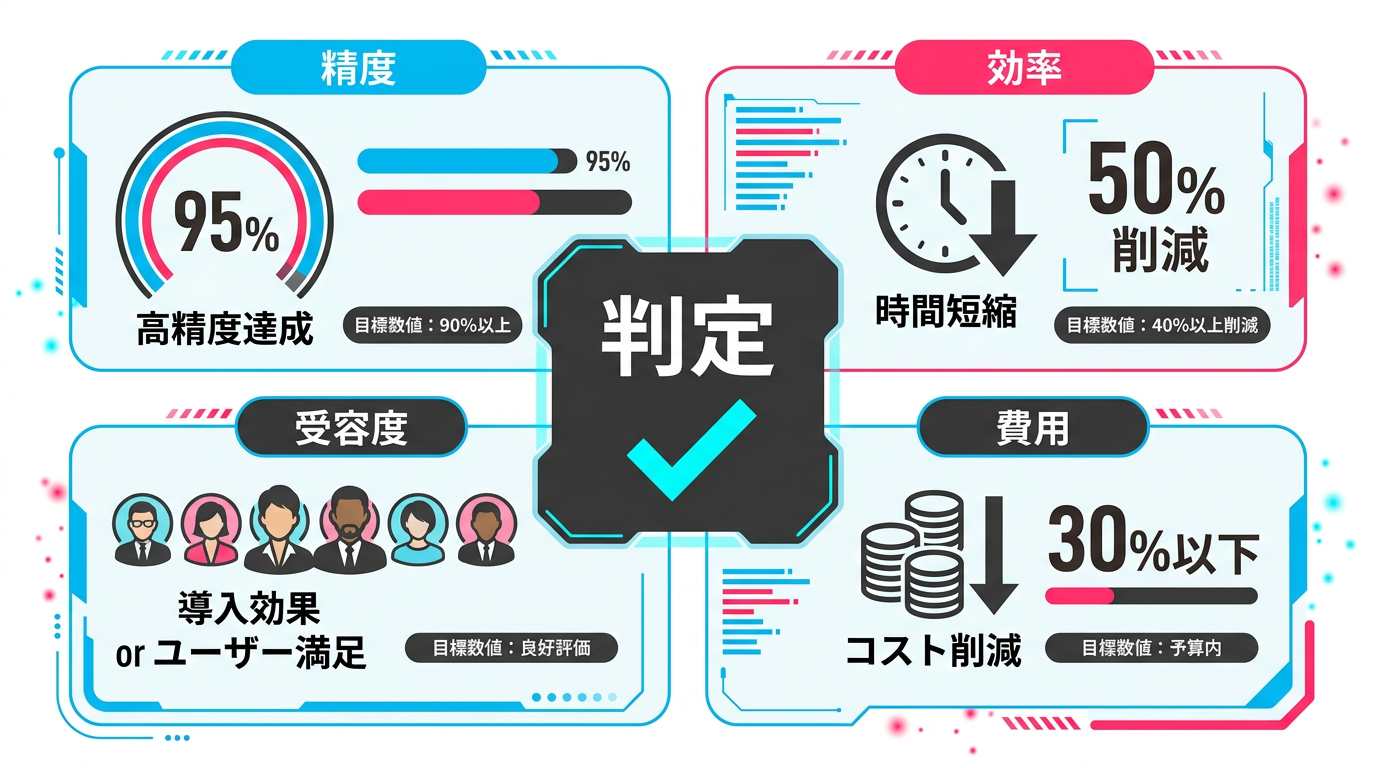

準備フェーズで最も重要なのは「PoC成功の定義」を明文化することです。私たちは以下の4つの指標を「PoC評価カード」として事前に設計します。

- 精度指標: 検出率(見逃さない力)と適合率(誤検出しない力)の目標値。審査業務では検出率95%以上、適合率85%以上が最低ラインです

- 効率指標: 1件あたりの審査時間の短縮率。目標は50%以上の削減

- 受容度指標: 現場担当者5名以上が「業務で使いたい」と評価するか

- コスト指標: 月間のAPI利用料が、削減される人件費の30%以下に収まるか

データ準備では、過去の審査データを最低100件収集します。この100件には「OK判定」と「NG判定」の両方を含め、さらにグレーゾーンの判断事例も10〜20件含めるのが理想です。データの品質がPoCの精度に直結するため、ここを妥協すると後から取り返しがつきません。

図2: PoC評価カード ― 4つの評価指標と目標値

フェーズ2: 設計と構築(1ヶ月目の後半)

やること: ツールのセットアップ、プロンプト設計、テストデータでの初期検証

ツール選定は、PoCの目的に合わせて3つの選択肢から選びます。審査業務のPoCでは、まず汎用LLMサービス(Claude API、GPT-4oなど)をAPIで直接呼び出す方法が最もスタートが早いです。業務特化型SaaS(LegalForceなど)が対象業務にフィットする場合は、そちらのトライアル利用も検討します。

プロンプト設計は、PoCの精度を左右する最重要工程です。審査業務向けのプロンプトは、以下の構造で設計します。

- 役割定義: 「あなたは○○業界の審査担当者です」

- チェック基準: 「以下のチェックリストに基づいて文書を審査してください」

- 出力形式: 「各チェック項目について OK/NG/要確認 の3段階で判定し、NG・要確認の場合は該当箇所と理由を出力してください」

- 判断例: 「以下は過去の審査事例です。同様の基準で判断してください」

プロンプトエンジニアリングで審査基準を定義する技術で詳しく解説していますが、チェック基準を構造化し、Few-shot(事例提示)でAIの判断精度を高めるアプローチが効果的です。

フェーズ3: 実験(2ヶ月目)

やること: パイロット実行、週次での計測と調整

実験フェーズでは、実際の業務で使いながら精度と効率のデータを蓄積します。ポイントは「AIチェックと人間チェックの並行実施」です。

最初の2週間は、AIの出力を現場担当者が全件レビューし、「AIの判断が正しかったか」を記録します。このデータが、フェーズ4の評価指標の算出に使われます。

3〜4週目は、AIの精度が低い箇所を特定し、プロンプトの調整やチェック基準の追加を行います。私たちの経験では、この「実験中の調整」が精度を10〜20ポイント引き上げるケースが多いです。週次の振り返りミーティングで「AIが間違えたケース」を共有し、パターンを分析します。

週次計測のすすめ

PoCの実験フェーズでは、週次で精度と効率の推移を記録してください。3ヶ月後にまとめて計測するよりも、週次の推移データがあることで「改善のトレンド」が見え、Go/No-Go判断の説得力が格段に上がります。

フェーズ4: 評価と判断(3ヶ月目)

やること: 結果分析、Go/No-Go判断、本番計画策定

3ヶ月目は、蓄積したデータをもとに「本番化するかどうか」を判断するフェーズです。ここでの判断基準は、フェーズ1で設定した「PoC評価カード」の4指標です。

Go/No-Go判断の考え方は以下の通りです。

Go(本番化を推奨): 4指標すべてが目標値を達成。本番化の計画を策定し、予算と体制の承認を取る

Conditional Go(条件付きで推奨): 精度・効率の2指標は達成しているが、受容度またはコストに課題がある。追加の施策(トレーニング実施、ツール変更など)を特定したうえで本番化に進む

Pivot(方向転換): 精度指標が未達だが改善の余地がある。対象業務の変更、ツールの変更、またはプロンプトの大幅改修を検討する

No-Go(中止): 技術的な限界により、現時点ではAI化の効果が見込めない。中止の判断自体がPoCの成果であり、失敗ではない

図3: Go/No-Go判断の4つのパス

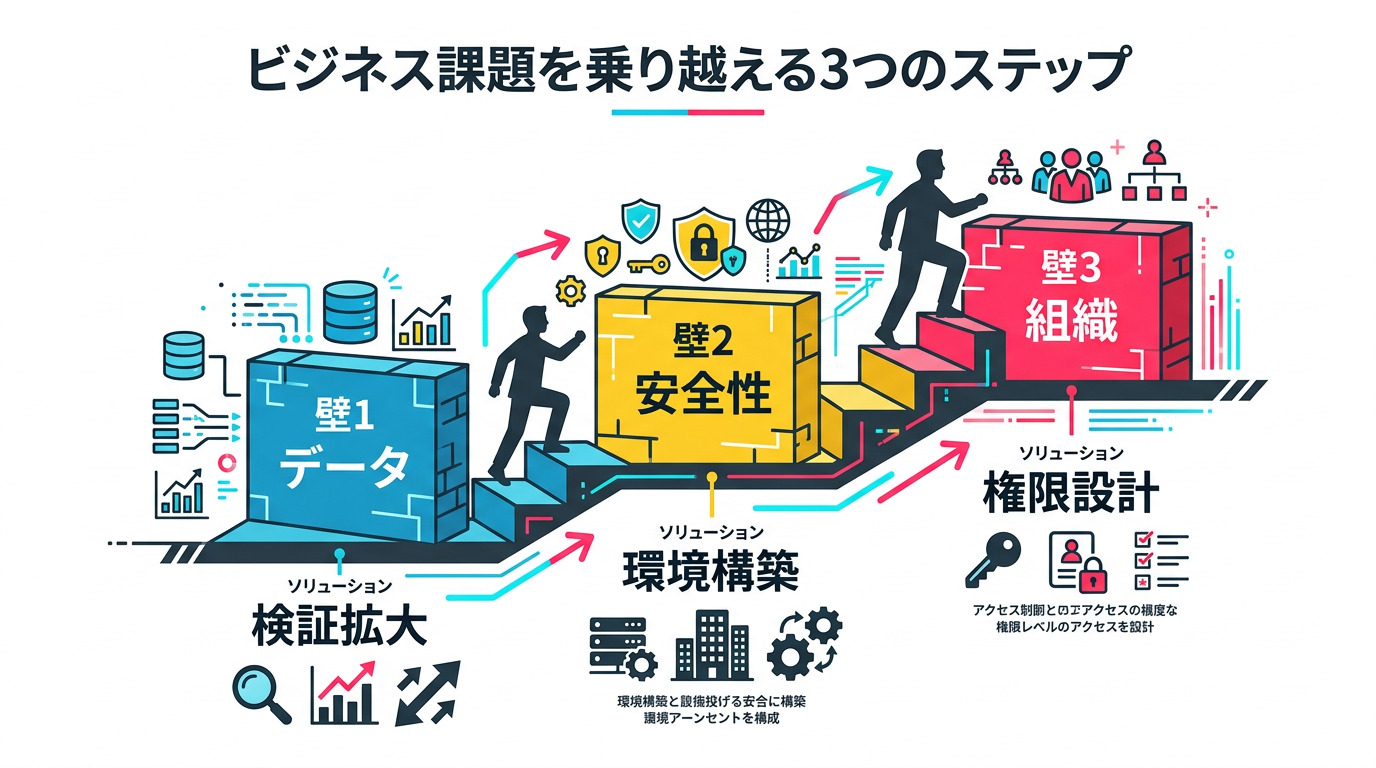

PoCから本番への「壁」を越える方法

PoCが成功しても、本番化には追加のハードルがあります。このギャップを「PoCの壁」と呼びますが、審査業務では3つの壁を越える必要があります。

壁1: データの壁 ― PoCデータと本番データの差

PoCでは厳選された100件のデータでテストしますが、本番では品質がバラバラな数千件のデータが流れ込みます。手書きの申請書、古いフォーマットの文書、記載漏れのある文書――PoCでは想定していなかったデータに対応する必要があります。

対策は、PoCの段階で「エッジケーステスト」を組み込んでおくことです。通常のデータだけでなく、意図的に品質の低いデータ(誤字が多い、フォーマットが崩れている、情報が欠けている)をテストケースに含めます。

壁2: セキュリティの壁 ― 本番レベルのデータ保護

PoCではテストデータ(匿名化済み)を使えますが、本番では実際の機密データを扱います。外部のLLMサービスを使う場合、データの送信先と保管ポリシーの確認が必須です。

2026年現在、Azure OpenAI ServiceやAmazon Bedrockなどのエンタープライズ向けサービスでは、データがモデルの学習に使用されない保証が提供されています。自社のセキュリティポリシーとの整合性を確認し、必要に応じてオンプレミス環境やVPC内でのモデル利用を検討します。

壁3: 組織の壁 ― 権限と責任の設計

「AIが誤判断した場合、誰が責任を取るのか」――この問いに答えられないと、本番化の承認は下りません。

審査業務では、AIの判断を「参考情報」として扱い、最終判断は人間が行うフローが基本です。ただし、すべての案件を人間が確認していたのではAI導入の効果が薄れます。私たちは「リスクベースの権限設計」を推奨しています。AIの判定確信度が高い(95%以上)かつリスクが低い案件は自動承認、それ以外は人間レビューに回すという設計です。AI導入事例まとめで紹介している成功事例でも、この段階的な権限委譲のアプローチが共通しています。

図4: PoCから本番化までの3つの壁と越え方

審査業務PoCの成功事例に学ぶ3つのパターン

私たちが支援してきた審査業務PoCの中から、成功パターンを3つ紹介します。

パターン1: 広告表現チェックのPoC(広告代理店・3ヶ月)

50人規模の広告代理店で、薬機法・景表法のNG表現チェックをAIで自動化するPoCを実施しました。対象は月間約200件の広告原稿です。

PoCのゴールは「一次チェックの検出率95%以上、審査時間の50%削減」。Claude APIを使い、過去のNG事例150件をFew-shotのサンプルとして学習させました。結果は検出率97%、審査時間の62%削減を達成し、Go判定で本番化に進みました。

パターン2: 契約書必須条項チェックのPoC(中堅メーカー・2ヶ月)

法務部3名の中堅メーカーで、NDA(秘密保持契約)の必須条項チェックをAIで自動化するPoCを実施しました。月間処理件数は約30件です。

件数が少ないため、Conditional Go判定となりました。精度は達成(検出率98%)したものの、コスト指標が微妙だったためです。最終的に、NDAだけでなく取引基本契約書も対象に含めて月間件数を80件に拡大し、本番化に進みました。

パターン3: 報告書品質チェックのPoC(コンサルティング会社・3ヶ月)

コンサルティング会社で、クライアント向け報告書の品質チェック(誤字脱字、数値の整合性、表現の統一性)をAIで自動化するPoCを実施しました。

このケースでは、Pivot判定となりました。誤字脱字の検出率は高い(96%)ものの、数値の整合性チェック(表とグラフの値が一致しているか)の精度が低かったためです。方向転換として、対象を誤字脱字・表現統一チェックに絞り、数値整合性チェックは人間が継続する形で再設計し、2回目のPoCで成功しました。

まとめ

AI PoCを「やって終わり」にしないためには、PoCの設計段階でゴールと評価基準を明確にし、本番化までの道筋を描いておくことが重要です。

- 3ヶ月タイムライン: 準備(2週間)→ 設計・構築(2週間)→ 実験(4週間)→ 評価・判断(4週間)

- PoC評価カード: 精度(検出率95%以上)、効率(時間50%削減)、受容度(現場5名が「使いたい」)、コスト(人件費削減の30%以下)の4指標で評価

- Go/No-Go判断: Go、Conditional Go、Pivot、No-Goの4段階で明確に判断。No-Goも立派なPoCの成果

- 本番化の3つの壁: データ品質、セキュリティ、組織の権限設計を事前に計画に組み込む

次のアクションとして、まず自社の審査業務の中からPoCの対象を1つ選び、「PoC評価カード」の4指標の目標値を設定するところから始めてみてください。AI審査モデルの評価指標も参考になります。

よくある質問(FAQ)

AI PoCの適切な期間はどのくらいですか?

3ヶ月が標準的です。1ヶ月目で準備と設計、2ヶ月目で実験、3ヶ月目で評価と判断を行います。3ヶ月を超えるとコストがかさみ、社内の関心も薄れるため、スピード重視で進めてください。もし3ヶ月で結論が出ない場合は、対象業務を絞り込んで再設計することを推奨します。

PoCに必要なデータ量はどのくらいですか?

最低でも過去の審査データ100件が目安です。このうち80件を精度検証に、20件をエッジケースのテストに使います。データが少ない場合は、PoCと並行してデータ蓄積の仕組みを作ることを推奨します。とくに「NG判定」のデータは業務によっては少ないため、意識的に収集する必要があります。

PoCが失敗した場合はどうすればよいですか?

失敗の原因を切り分けることが最も重要です。精度が不足なら対象業務の変更やプロンプト改善、コストが合わないならツール変更、現場の受容度が低いなら運用フローの見直しを検討します。「No-Go」の判断自体がPoCの価値ある成果です。何が原因でうまくいかなかったかを記録し、次のPoCに活かしてください。

PoCの費用はどのくらいかかりますか?

クラウド型AIサービスの利用料は月額数万円程度です。外部コンサルを入れる場合は3ヶ月で100〜300万円が相場ですが、社内リソースだけで進める場合は担当者の工数(月20〜40時間程度)が主なコストになります。ROIの観点では、PoC費用を「投資判断のための情報収集コスト」と位置づけ、本番化後の年間削減効果と比較して評価するのが適切です。

この記事の著者

Naosy 編集部

レビュー・校正・審査プロセスの最適化に関する実践的なナレッジを発信しています。