社内レビュー文化をAI時代にアップデートする方法 ― 役割再定義から評価制度まで

AIを導入しても現場で使われない原因は技術ではなく組織文化にあります。審査担当者の役割再定義、スキルシフトの設計、評価制度の見直し、抵抗勢力への対応まで、AI時代のレビュー文化を構築する実践手法を解説します。

「AIに仕事を奪われるんじゃないか」――審査AIの導入プロジェクトで、現場から最も多く聞く不安がこれです。 しかし私たちの経験では、この不安に正面から向き合わないプロジェクトは、どんなに高精度なAIを導入しても定着しません。BCG(ボストン コンサルティング グループ)の2025年調査によると、AI導入企業の80%で従業員がAIツールを無視するか表面的にしか使っていないという結果が出ています。

技術の問題ではありません。組織文化の問題です。審査担当者が「自分はこれからどう評価されるのか」「AIが間違えたら誰が責任を取るのか」「何年もかけて積み上げた専門知識に意味がなくなるのか」――これらの問いに答えないまま、AIを導入しても使われないのは当然です。

この記事では、審査チームの「レビュー文化」をAI時代に合わせてアップデートするための具体的な手法を、役割再定義・スキルシフト・評価制度・抵抗対応の4つの軸で解説します。

「AIを入れたのに使われない」3つの根本原因

AIが現場に定着しない原因は、技術的な不備ではなく以下の3つの組織的な問題にあります。

原因1: 審査担当者の役割が再定義されていない

AIの導入によって「これまで通りのチェック作業」が減ります。しかし、減った分の業務で何をすべきかが定義されていないと、審査担当者は「自分が不要になる」と感じます。審査AI導入の6フェーズのPhase 6(定着化)で強調したチェンジマネジメントの本質は、ここにあります。

原因2: 評価制度が変わっていない

多くの審査チームは「処理件数」で成果を測定しています。AIが一次チェックを担うと、人間が処理する件数は激減します。しかし評価基準が件数のままだと、AIを使えば使うほど自分の評価が下がることになります。これでは現場がAIを使うインセンティブがありません。

原因3: AIへの信頼形成が設計されていない

「AIの精度は90%です」と言われても、現場の審査担当者は「残りの10%で致命的なミスが起きたらどうするのか」と考えます。審査AIの判断根拠を説明できる設計で解説したXAI(説明可能AI)の実装は、技術的な要件であると同時に、信頼形成の手段でもあります。

定着率の目安

AI導入3ヶ月後の週次アクティブユーザー率が70%を下回っている場合、組織文化の問題を疑ってください。技術的な改善よりも先に、以下に解説する役割再定義と評価制度の見直しに着手することをお勧めします。

審査担当者の役割再定義 ― 「判定者」から「キュレーター」へ

AI時代の審査担当者の役割を、「全件をチェックする判定者」から「AIの品質を管理するキュレーター」に再定義します。

新しい役割の3つの柱

柱1: AIが判断できないケースの対応(例外対応)

AIの確信度が低いケース、新しいパターンのケース、複数の審査基準が競合するケース。これらの「AIが判断に迷うケース」に対して、専門知識を活かして判断するのが新しい中核業務です。ルーティンの全件チェックから解放されることで、本来時間をかけるべき難しいケースに集中できます。

柱2: 審査基準の明文化と改善

ベテラン審査者の頭の中にある暗黙知を、AIが理解できる形(プロンプトやルール)に落とし込む作業です。「なぜこのケースはNGなのか」を言語化し、プロンプトに反映させることで、AIの精度向上に直接貢献します。審査担当者のためのプロンプト作成ガイドで詳しく解説する予定ですが、この「暗黙知の言語化」はAI時代の審査担当者にとって最も価値の高いスキルです。

柱3: AIの品質モニタリングと改善提案

審査AIの品質モニタリングで解説した週次レビューの場で、AIの誤判定パターンを分析し、改善策を提案する役割です。「なぜAIがこの判定を間違えたのか」を分析できるのは、審査業務を深く理解している現場の担当者だけです。

役割再定義を現場に伝えるための3つのメッセージ

役割を再定義しても、現場に正しく伝わらなければ意味がありません。以下の3つのメッセージを明確に伝えてください。

- 「仕事がなくなるのではなく、仕事の中身が変わる」: ルーティン作業が減る代わりに、より判断力が求められる仕事が増える

- 「あなたの専門知識がAIの精度を決める」: AIの精度は、審査担当者がプロンプトやルールに落とし込んだ知識の質に依存する

- 「AIの監督者として、これまで以上に重要な存在になる」: AIは道具であり、その道具を正しく使いこなすのは人間の役割

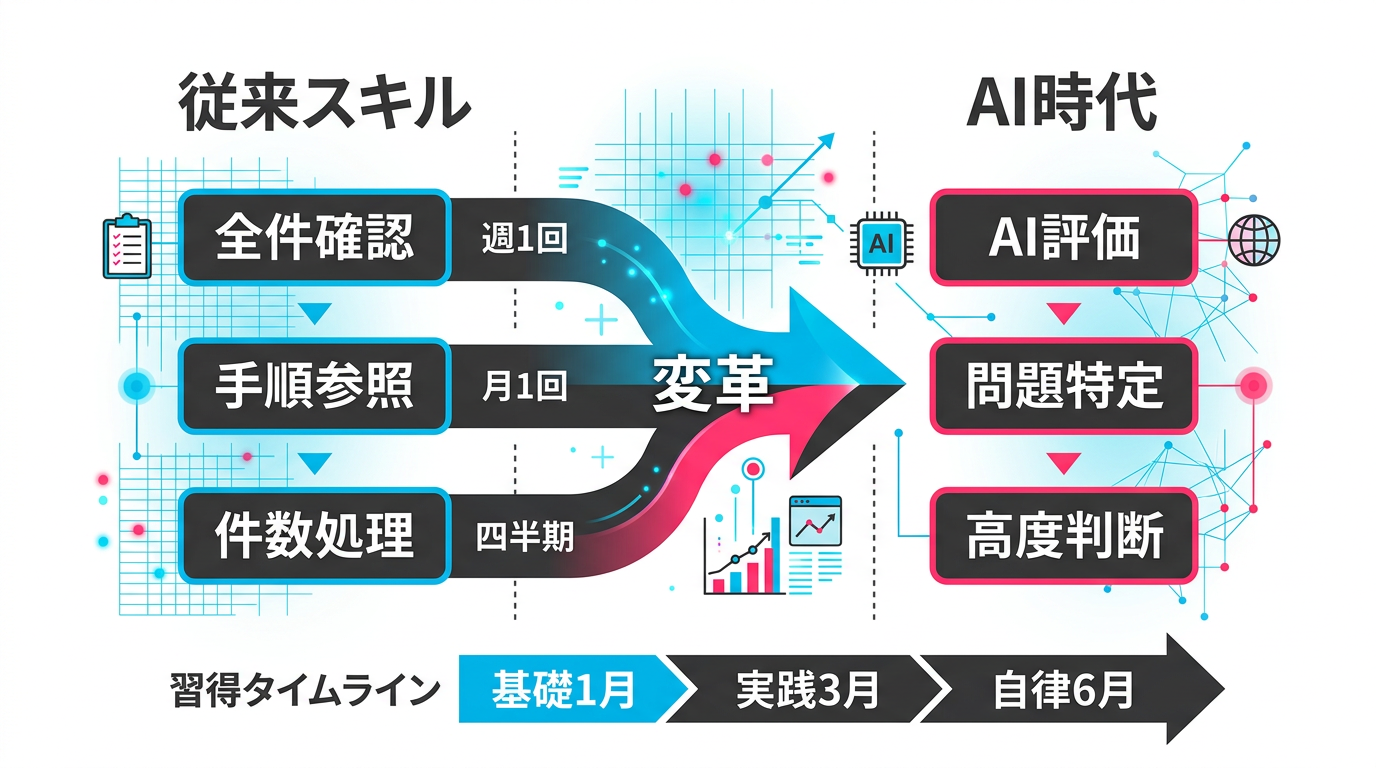

スキルシフトとトレーニング設計

役割が変わる以上、必要なスキルも変わります。2026年の審査担当者に求められる3つの新スキルと、そのトレーニング方法を整理します。

スキル1: AI出力評価力

AIの判定結果が正しいかを評価する能力です。「なぜOKと判定したのか」「この判定の確信度は妥当か」を判断できる力が必要です。Claude 4.6 SonnetやGPT-5.4はChain-of-Thought(段階的推論)で判定理由を出力するため、その推論過程が論理的かを評価するスキルが求められます。

トレーニング方法: AIの判定結果と人間の判定結果を比較する「答え合わせセッション」を週1回、30分間実施。最初は正解付きのサンプルで練習し、徐々に正解がないケースで判断する練習に移行します。

スキル2: 問題特定・改善提案力

AIが間違えるパターンを発見し、改善策を提案する能力です。「カテゴリAの否定表現でAIがよく間違える」といった傾向を見つけ、「プロンプトにカテゴリAの否定表現の判定例を3件追加する」といった具体的な改善提案ができることが目標です。

トレーニング方法: 誤判定事例を5件ずつチームで共有し、「原因」と「対策案」を議論するワークショップ。月1回、60分間で実施。参加者全員が改善案を出す形式にします。

スキル3: 高度判断力

AIが対応できない例外ケースやグレーゾーンに対して、多角的に判断する能力です。法的リスク、ブランドリスク、社会的影響を総合的に考慮した判断が求められます。この能力は従来の審査業務でも求められていたものですが、AI導入後はこのスキルに集中できるため、より高い水準が期待されます。

トレーニング方法: 過去の困難なケースを教材にしたケーススタディ研修。四半期に1回、半日で実施。外部の法律専門家を招いた勉強会を組み合わせると効果的です。

図2: スキルシフトの全体像 ― 従来スキルからAI時代スキルへ

図2: スキルシフトの全体像 ― 従来スキルからAI時代スキルへ

評価制度の見直し ― 「件数」から「品質+改善貢献」へ

役割とスキルが変わるなら、評価制度も変えなければなりません。AI導入後の評価制度は「処理件数」から「品質と改善への貢献度」に軸を移します。

新しい評価指標の設計

定量指標(60%)

- 例外対応の判断品質: AIがエスカレーションしたケースに対する判断の正確さ。上位レビューアのレビュー結果との一致率で測定

- AI改善貢献度: AIの誤判定を発見・報告した件数、プロンプトやルールの改善提案を行った回数

- 対応速度: エスカレーションされたケースの処理時間。SLA内に処理できた割合

定性指標(40%)

- ナレッジ共有: チーム内での知見共有やトレーニングへの貢献

- グレーゾーン判断: 明確な基準がないケースでの判断の質(上位レビューアが評価)

- 改善提案の質: 提案した改善策が実際にAIの精度向上に貢献したか

導入時の注意点

評価制度の変更は、突然行うと混乱を招きます。以下のステップで段階的に移行します。

- Phase 1(導入後1〜3ヶ月): 新しい評価指標を「試験導入」として追跡開始。ただし昇給・賞与には反映しない。従来の件数ベースの評価と並行して運用

- Phase 2(4〜6ヶ月): 新旧の評価指標を50:50のウェイトで運用。四半期フィードバックで新指標の妥当性を検証

- Phase 3(7ヶ月以降): 新しい評価指標に完全移行。旧指標(処理件数)は参考値として残すが、評価の主軸にはしない

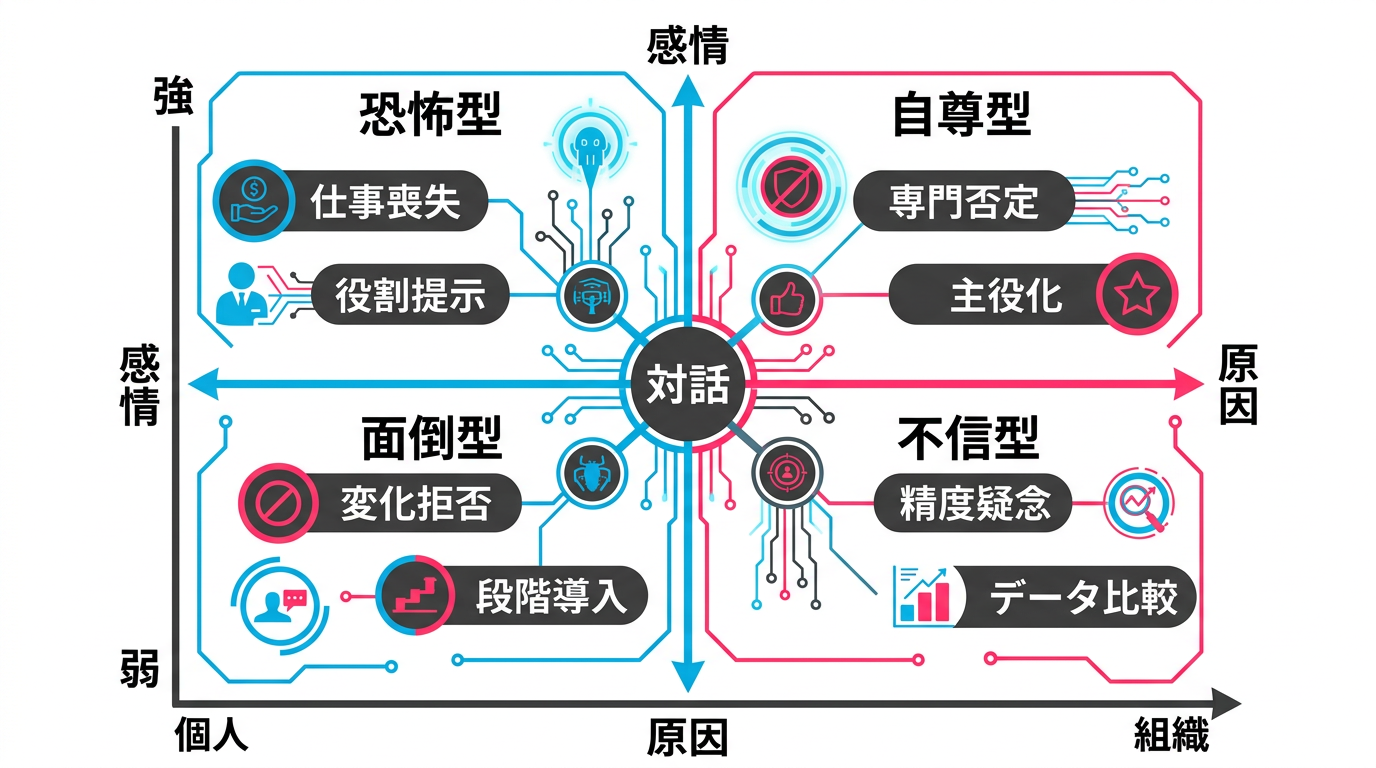

抵抗勢力への対応 ― 4つのパターンと処方箋

AI導入に対する現場の抵抗は避けられません。重要なのは、抵抗を「排除」するのではなく「理解して対応」することです。

パターン1: 恐怖型 ― 「仕事がなくなる」

最も多いパターンです。処方箋は、具体的な「新しい役割」を示すことです。「全件チェックはAIがやります。あなたにはAIが判断できない難しいケースの対応と、AIの精度を改善する仕事をお願いします」と、具体的に何をするかを伝えます。他社の成功事例(AI導入後にチームの業務価値が上がった事例)を共有するのも効果的です。

パターン2: 不信型 ― 「AIは信頼できない」

AIの精度に疑念を持つタイプです。このタイプには、データで説明するのが最も効果的です。AIと人間の判定結果を並べて比較する「精度比較レポート」を定期的に共有し、AIが人間と同等以上の精度で判定できていることを示します。さらに、AIの判定を覆した場合に「なぜ覆したか」を記録する仕組みを作り、その記録から「AIが間違えやすいパターン」を特定して改善する流れを作ると、不信が「建設的な改善提案」に転換できます。

パターン3: 面倒型 ― 「今のやり方で困っていない」

変化そのものを面倒に感じるタイプです。段階的な導入で「新しいやり方」の負担を最小化します。最初は1つのチェック項目だけAIに任せ、その効果を実感させてから範囲を広げる。「一気に変える」のではなく「少しずつ移行する」アプローチが有効です。

パターン4: プライド型 ― 「自分の専門性が否定された」

長年の経験を持つベテランに多いパターンです。最も効果的な対策は、ベテランこそAI導入の主役にすることです。「あなたの専門知識がなければ、AIは正しく判定できません。プロンプトに入れる審査基準は、あなたの知識から作ります」と、AIの精度がベテランの知識に依存していることを明示します。可能であれば「AIチャンピオン」(部門内のAI推進役)としてベテランを任命し、AIプロジェクトの中心メンバーにします。

図4: 抵抗パターンの分類と対応策

図4: 抵抗パターンの分類と対応策

まとめ

AI時代のレビュー文化のアップデートは、技術導入以上に重要なプロジェクトです。

- 役割を再定義する: 「全件チェックの判定者」から「AIの品質管理キュレーター」へ。例外対応、基準の明文化、品質モニタリングが新しい中核業務

- スキルシフトを設計する: AI出力評価力、問題特定・改善提案力、高度判断力の3つを段階的にトレーニング

- 評価制度を変える: 「処理件数」から「品質+改善貢献」へ。6ヶ月かけて段階的に移行

- 抵抗には4パターンで対応: 恐怖型・不信型・面倒型・プライド型それぞれに適切な処方箋を用意

次のアクションとして、自社の審査チームの評価制度を確認してください。「処理件数」が主要な評価指標になっていたら、今すぐ新しい評価指標の設計を始めることをお勧めします。評価制度がAI活用と矛盾しているかぎり、どんなに優れたAIを導入しても現場では使われません。

よくある質問(FAQ)

AIを導入しても現場で使われないのはなぜですか?

主な原因は3つあります。審査担当者が「自分の仕事がなくなる」と感じている、AIの判定を信頼する根拠が示されていない、評価制度が従来の「件数ベース」のままでAI活用にインセンティブがない。技術の問題ではなく、組織文化と制度の問題です。

AI時代の審査担当者にはどんなスキルが必要ですか?

3つのスキルが重要です。AIの判定結果を評価・検証する「AI出力評価力」、AIの誤判定パターンを分析して改善策を提案する「問題特定・改善提案力」、例外ケースやグレーゾーンに対応する「高度判断力」です。従来の「全件チェック」から「AIが判断できないケースの対応」にシフトします。

AI導入に反対する社員にはどう対応すべきですか?

反対の動機は4パターンあります。仕事を奪われる恐怖(安心材料の提示で対応)、AIの精度への不信(データで実績を示す)、変化への面倒さ(段階的な導入で負担を減らす)、自分の専門性の否定と感じている(AI監督者としての新しい専門性を提示)。最も効果的なのは、反対している人を「AIチャンピオン」として巻き込むことです。

評価制度はどう変えるべきですか?

「審査件数」から「審査品質+改善貢献」に軸を変えます。具体的には、AIの誤判定を発見・報告した件数、プロンプト改善に貢献した回数、例外ケースの判断品質を評価項目に加えます。AI活用そのものを評価することで、現場のインセンティブをAI活用に向けます。

この記事の著者

Naosy 編集部

レビュー・校正・審査プロセスの最適化に関する実践的なナレッジを発信しています。